更多>>关于我们

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

更多>>技术文章

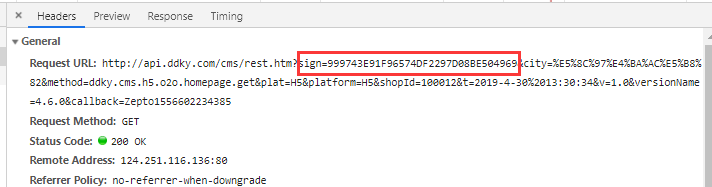

叮当快药(http://m.ddky.com/)的所有Ajax请求,都有一个sign参数(如下图所示),

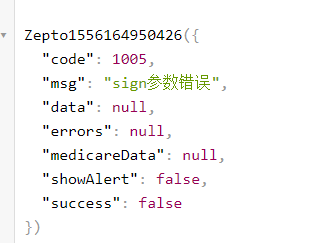

如果修改了URL中的参数,服务端就会提示签名参数错误(如下图所示)。

这是一种现在很常见的反采集策略(签名验证机制),在手机App中的应用尤为广泛,在我们之前的技术文章中也多次提到。

这个签名参数(sign)是通过特定的算法对HTTP请求提交的其它参数计算而来的,服务器接收到HTTP请求之后会使用相同的算法计算出一个sign值,并和HTTP请求中的sign值做比较,如果不一致就认为这是一个无效的请求。

如果我们能解决这个算法就能自己构造出有效的sign值。那如何解决呢?

·对于安卓App来说我们可以通过反编译APK获取Java源码来实现。

·对于Web网站来说,我们可以通过分析网站的JS代码来实现。

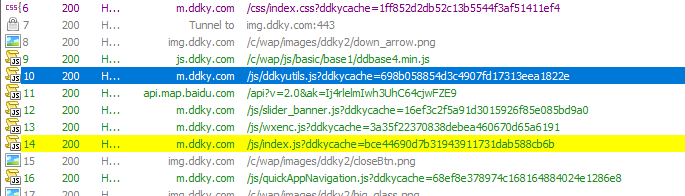

在众多JS文件中寻找一个签名算法有点大海捞针的感觉,我们可以通过Fiddler的内容搜索功能,通过搜索"sign="这种关键词,快速定位算法所在的文件(如下图所示)。

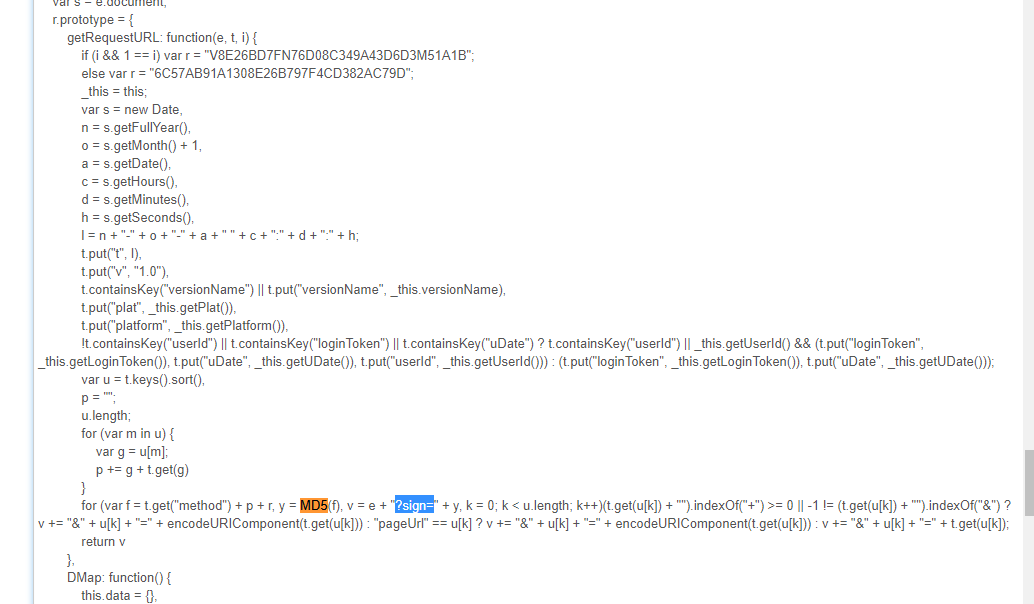

通过查找最后定位到ddkyutils.js这个文件,如下图所示为计算sign参数的关键代码:

核心的一句是:

f = t.get("method") + p + r, y = MD5(f), v = e + "?sign=" + y

可以看出:sign = MD5(method + p + r)

·method就是请求URL中的method参数;

·p参数的构造方法JS代码中可以看到,它是根据url中除了sign和callback以外的其它参数,按照先后顺序拼接而成;

%u25CF;通过JS代码可以看出r是固定参数(固定值6C57AB91A1308E26B797F4CD382AC79D);

下面验证下这个算法:

chrome发出的一个实际的请求(根据店铺ID和分类获取分类下的商品):

http://api.ddky.com/cms/rest.htm?sign=CD6AA445E364C59A71561186E5992991&city=%E6%9D%AD%E5%B7%9E%E5%B8%82&compositeId=20&idfa=F4773FA6FA05AE09970A2AEB58E83AC0&lat=30.252614410934047&lng=120.2163546837817&method=ddky.cms.search.cate.list.recipe&orderTypeId=0&pageNo=1&pageSize=20&plat=H5&platform=H5&shopId=204174&suite=1&t=2019-4-25%2012:2:30&userId=&v=1.0&versionName=5.2.0&wd=&callback=Zepto1556164950426

上述请求对应的p参数的值(根据除了sign和callback参数之外的其它参数构造,按参数在url里的先后顺序)构造如下:

city杭州市compositeId20idfaF4773FA6FA05AE09970A2AEB58E83AC0lat30.252614410934047lng120.2163546837817methodddky.cms.search.cate.list.recipeorderTypeId0pageNo1pageSize20platH5platformH5shopId204174suite1t2019-4-25 12:2:30userIdv1.0versionName5.2.0wd

sign的计算方法:

sign = MD5(method + p + r)

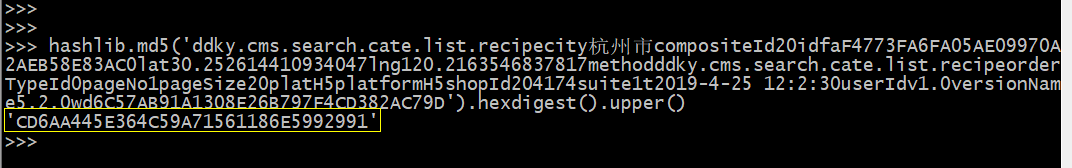

Python测试如下:

>>> hashlib.md5('ddky.cms.search.cate.list.recipecity杭州市compositeId20idfaF4773FA6FA05AE09970A2AEB58E83AC0lat30.252614410934047lng120.2163546837817methodddky.cms.search.cate.list.recipeorderTypeId0pageNo1pageSize20platH5platformH5shopId204174suite1t2019-4-25 12:2:30userIdv1.0versionName5.2.0wd6C57AB91A1308E26B797F4CD382AC79D').hexdigest().upper()

>>>

'CD6AA445E364C59A71561186E5992991'

如下图所示,可以看到我们计算出来的sign和浏览器发出的sign一致(均是CD6AA445E364C59A71561186E5992991)。

完整叮当快药签名参数(sign)计算过程Python代码如下:

import re

import urllib

import hashlib

# 原始参数,无sign和callback参数

url_params = 'city=%E6%9D%AD%E5%B7%9E%E5%B8%82&compositeId=20&idfa=F4773FA6FA05AE09970A2AEB58E83AC0&lat=30.252614410934047&lng=120.2163546837817&method=ddky.cms.search.cate.list.recipe&orderTypeId=0&pageNo=1&pageSize=20&plat=H5&platform=H5&shopId=204174&suite=1&t=2019-4-25%2012:2:30&userId=&v=1.0&versionName=5.2.0&wd='

# method参数

method = re.compile(r'method=([^&]+)').search(url_params).groups()[0]

# 构造出来的p参数

p = urllib.unquote_plus(url_params.replace('=', '').replace('&', ''))

# r参数的值固定

r = '6C57AB91A1308E26B797F4CD382AC79D'

# 计算sign

sign = hashlib.md5(method + p + r).hexdigest().upper()

print sign