更多>>关于我们

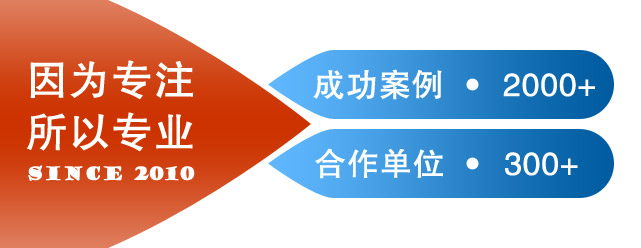

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

更多>>技术文章

折叠什么是Web数据抓取?

Web数据抓取(Web scraping,也叫Web数据采集)指的是批量、快速从网站上提取信息的一种计算机软件技术。Web数据抓取程序模拟浏览器的行为,能将可以在浏览器上显示的任何数据提取出来,因此也称为屏幕抓取(Screen scraping)。Web数据抓取的最终目的是将非结构化的信息从大量的网页中抽取出来以结构化的方式存储(CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等)。

折叠Web数据抓取有什么用处?

任何业务运营成功的基础是拥有大量的目标用户和专业数据,谁能把握用户,谁就能占得先机。Web数据抓取服务可以帮您迅速获得大量的目标用户和专业数据,使您在降低运营成本的同时,迅速抢占先机,占领制高点。 许多的客户都直接从我们的服务或者定制软件中获益。

许多的客户都直接从我们的服务中获益。

您能把我们的服务用于以下方面:

- 产生您的潜在客户列表

- 从您的竞争对手中收集您感兴趣的信息

- 抓取新兴业务数据

- 建立您自己的产品目录

- 整合行业信息,辅助经营决策

- 建立垂直搜索引擎

- Web系统自动化

- 舆情监控等等

折叠Web数据抓取有什么好处?

简单: 您不需要使用任何的软件,只需要告诉我们您的目标网站和你感兴趣的内容。

弹性: 您能从任何的网站上获取任何数据,特别是动态网站上的数据。

快捷: 对于一个需要20个人工作日完成的工作,我们能在数小时内完成。

定制: 针对不同的目标网站定制采集程序,灵活应对不同的异构网站。

精确: 抽取结果的每一列都是您所需要的,不多也不少。

低价: 您可以节省无法以金钱来计量的时间和精力,以及数倍于所付费用的人工和设备投入!

折叠Web数据抓取是否合法?

Web数据抓取程序的原理类似于搜索引擎的爬虫。

1、信息是不具有版权的,任何人都可以使用他人已公开的信息;

2、信息的组织和编撰具有版权,如果你完全使用对方网站上信息的编排方式和编排文字的话,可能存在版权侵权的行为。