更多>>关于我们

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

更多>>技术文章

在一次Web回话过程中,到底是谁先主动关闭的TCP连接呢?是服务端还是客户端?本次实验将解开谜底。

先插播点小知识:TCP的TIME_WAIT状态,是主动关闭TCP连接一方才会出现的状态(详细介绍可以参加这篇文章https://www.cnblogs.com/sunxucool/p/3449068.html),借助该状态我们就可以判断出是谁先说的Goodbye。

下面我们会分别测试Curl、Python urllib2和Python requests库的情况。

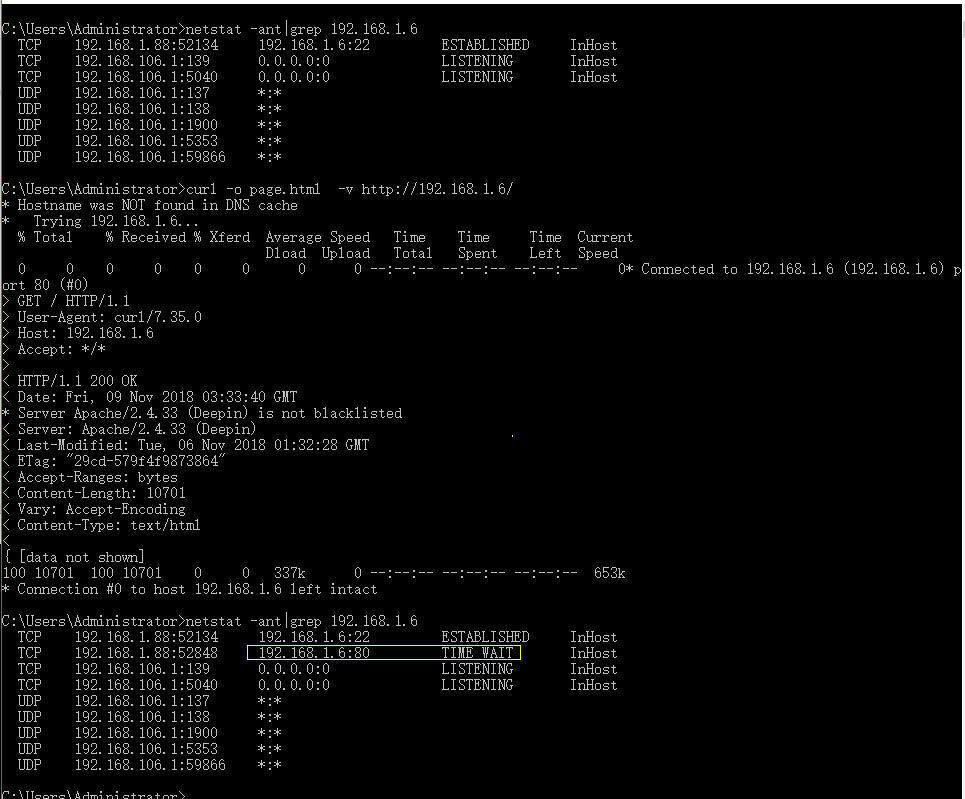

1. Curl连接Apache,谁先关闭连接?

答案是:客户端(curl)。

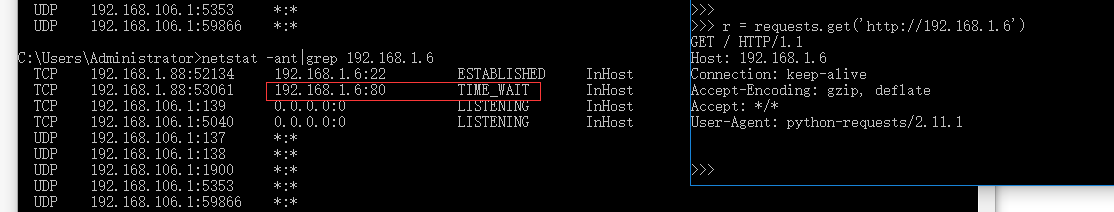

如下图所示,TIME_WAIT出现在客户端,因此TCP连接是curl主动关闭的。

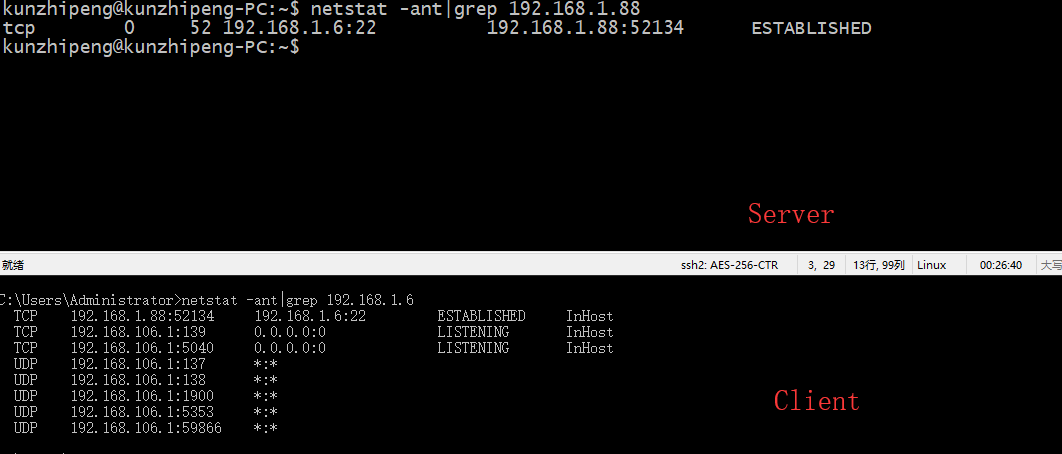

2. Python urllib2连接Apache,谁先关闭连接?

答案是:服务端(Apache)。

测试前状态如下图1所示。

测试后(urllib2连接web之后)状态如图2所示。TIME_WAIT出现在服务端,因此可以断定TCP连接是Apache主动关闭的。

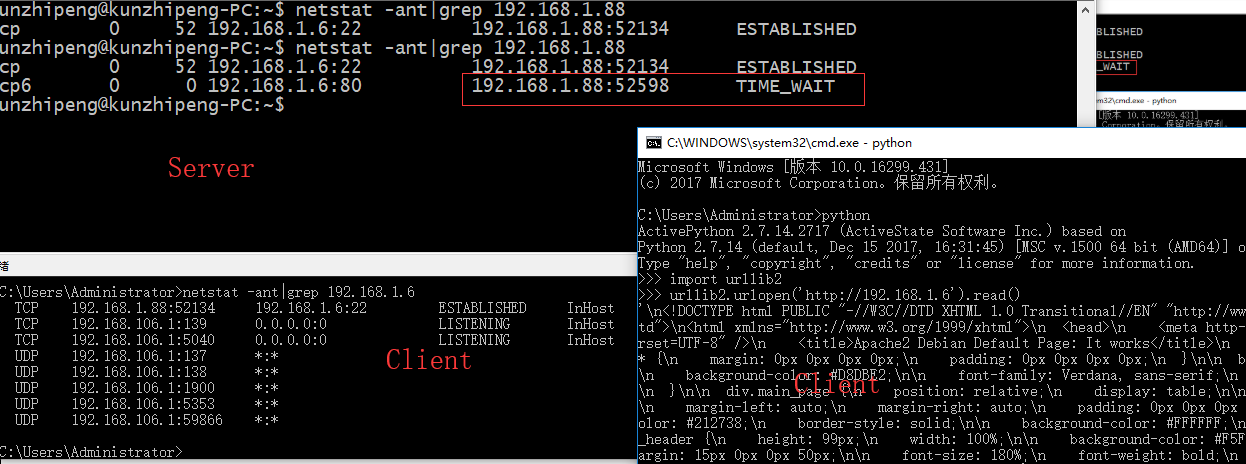

urllib2的行为可以深究一下,为什么服务端(Apache)会主动关闭连接?

先给httplib.py做点手脚,让其能打印出发出的HTTP请求数据,如下图所示。可以看到发出的请求被自动加上了"Connection: close",告知服务端发送请求完毕后关闭连接,因此Web服务端主动关闭请求。

作为对比,可以再看下curl测试时的截图,curl发出的HTTP请求报文并没有"Connection: close"头,因此服务端处理完请求并不会主动关闭连接。

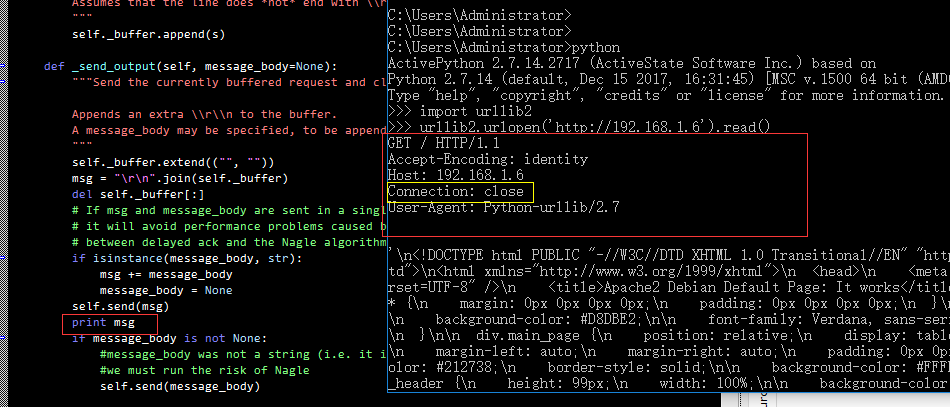

3. Python requests连接Apache,谁先关闭连接?

第一种情况,不使用requests的session,答案是:客户端(requests)。

如下图所示,发送请求之后客户端出现了TIME_WAIT。

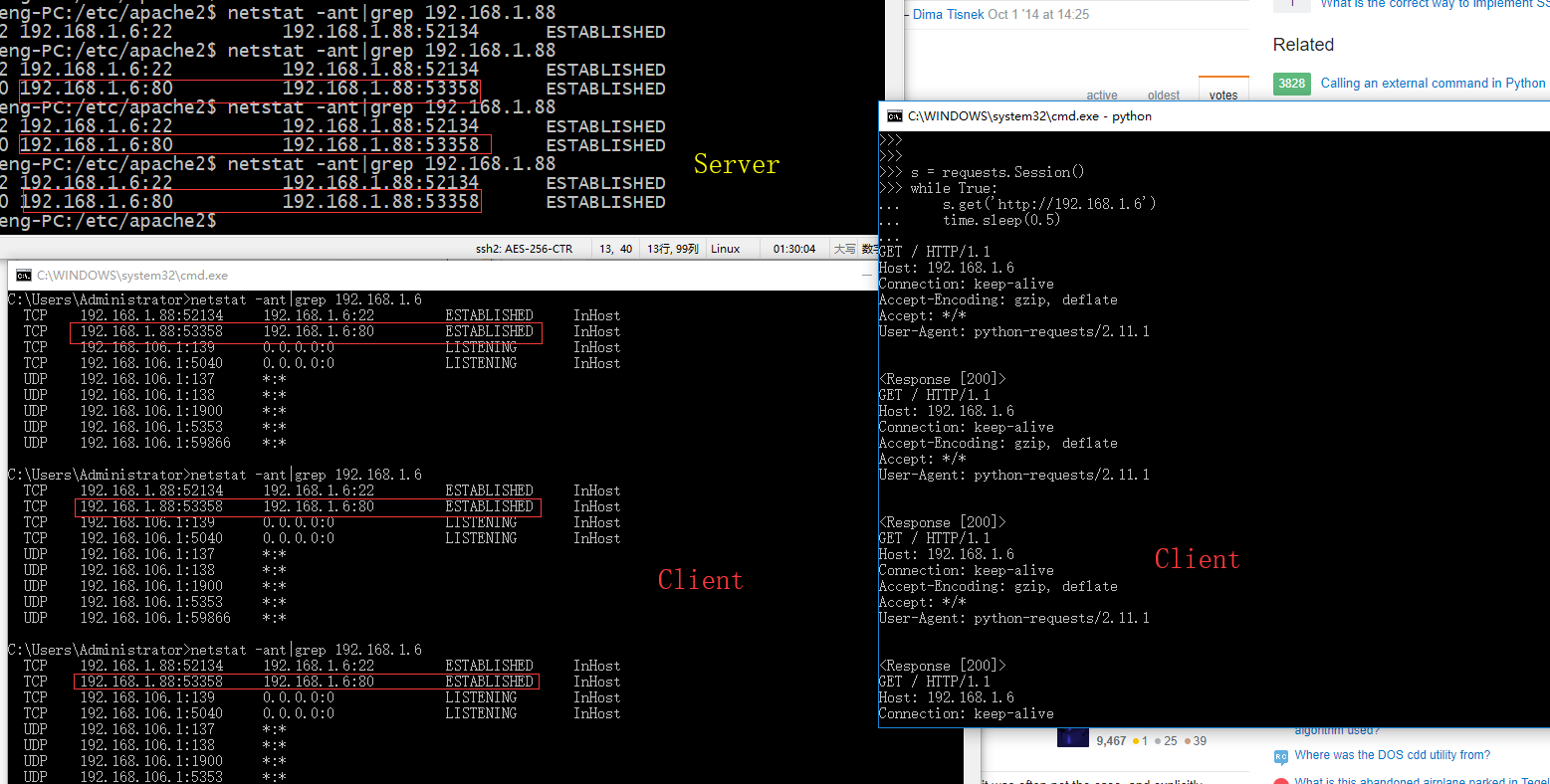

第二种请求,使用requests的session,这时候客户端和服务端将保持长连接,如果请求一直持续连接将一直保持,不会主动关闭,如下图所示。

需要注意的是,客户端必须一直有持续的请求发出长连接才会被保持,实验中每隔0.5秒请求一次)。如果客户端休息了一段时间,那么服务端就开始尝试关闭连接了。

4. 把Apache服务器换成HTTP代理服务器情况如何呢?

把Web服务器(Apache)换成HTTP代理服务器情况也一样,比如:

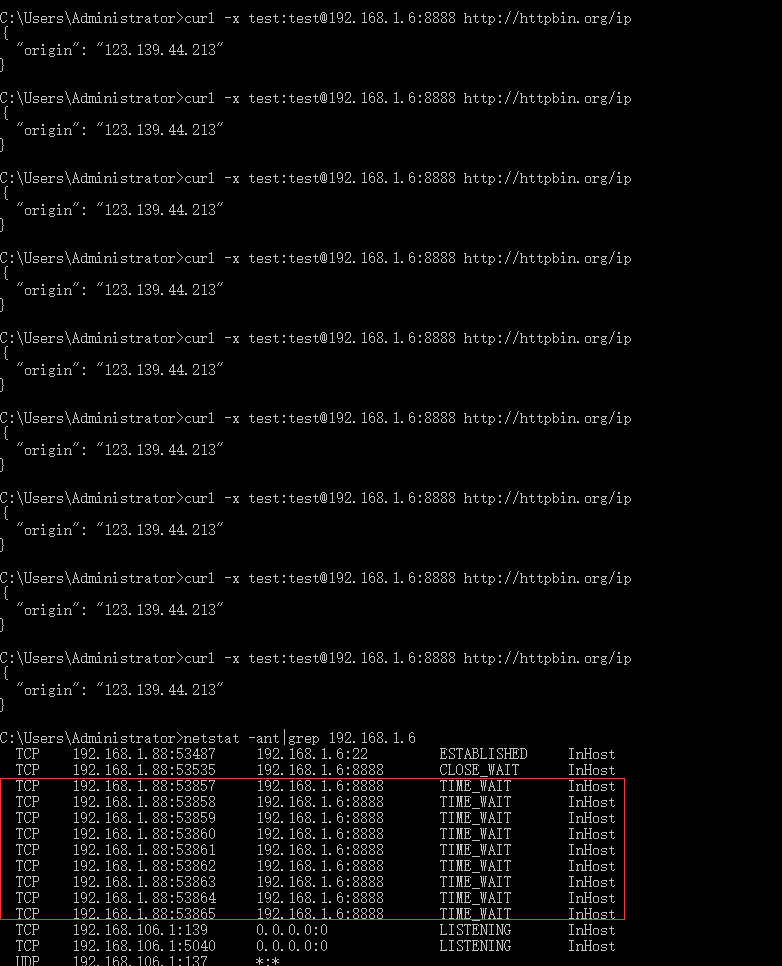

1. 连续执行9次curl -x test:test@192.168.1.6:8888 http://httpbin.org/ip 之后,本地可以看到9个TIME_WAIT状态的TCP连接。

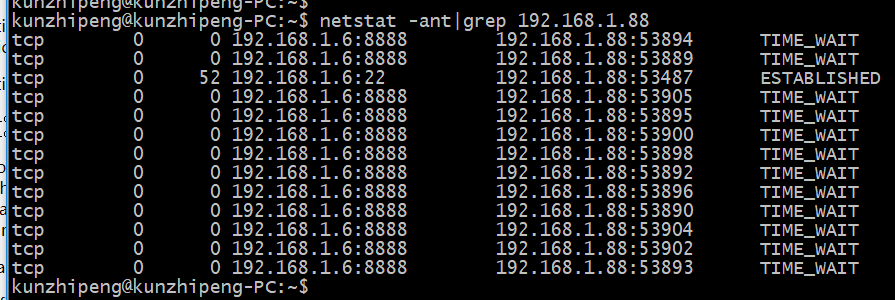

2. 再比如,我们用urllib2使用代理(test:test@192.168.1.6:8888)访问任意网址多次,代理服务器上就会出现多个状态为TIME_WIAT状态的TCP连接。如下图所示:

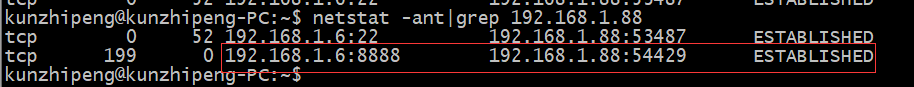

3. 如果我们用requests + session模式,通过代理访问任意网址多次,代理服务器上只有一条来自requests客户端的TCP连接。如下图所示。

总结:在做爬虫开发的时候尽快使用支持长连接的HTTP客户端,例如request + session。这样即能提高效率(建立TCP连接需要耗费时间),也能减轻客户端和Web服务端(或HTTP代理服务器)的负担。