更多>>关于我们

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

更多>>技术文章

用xpath还是正则表达式?

发布时间:2018-07-16

xpath和正则表达式是数据提取时最常用的两种方法,究竟用哪个好呢?相信看过本文后你会有一个果断的选择。

测试代码如下所示,实验目标是同一HTML文档,分别使用webscrpaing库中的xpath,lxml库中的xpath以及正则表达式提取100次,统计各方法的用时:

# coding: utf-8

# xpath_speed_test.py

import re

import time

from lxml import etree

from webscraping import common, download, xpath

TEST_TIMES = 100

def test():

url = 'http://hotels.ctrip.com/international/washington26363'

html = download.Download().get(url)

html = common.to_unicode(html)

# 测试webscraping库的xpath提取速度

start_time = time.time()

for i in range(TEST_TIMES):

for hid, hprice in zip(xpath.search(html, '//div[@class="hlist_item"]/@id'), xpath.search(html, '//div[@class="hlist_item_price"]/span')):

#print hid, hprice

pass

end_time = time.time()

webscraping_xpath_time_used = end_time - start_time

print '"webscraping.xpath" time used: {} seconds.'.format(webscraping_xpath_time_used)

# 测试lxml库xpath提取速度

start_time = time.time()

for i in range(TEST_TIMES):

root = etree.HTML(html)

for hlist_div in root.xpath('//div[@class="hlist_item"]'):

hid = hlist_div.get('id')

hprice = hlist_div.xpath('.//div[@class="hlist_item_price"]/span')[0].text

#print hid, hprice

pass

end_time = time.time()

lxml_time_used = end_time - start_time

print '"lxml" time used: {} seconds.'.format(lxml_time_used)

# 测试正则表达式的速度

start_time = time.time()

for i in range(TEST_TIMES):

for hid, hprice in zip(re.compile(r'class="hlist_item" id="(\d+)"').findall(html), re.compile(r'<div class="hlist_item_price"><dfn>¥</dfn><span>([\d\.]+)</span>').findall(html)):

#print hid, hprice

pass

end_time = time.time()

re_time_used = end_time - start_time

print '"re" time used: {} seconds.'.format(re_time_used)

if __name__ == '__main__':

test()

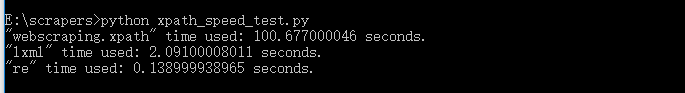

运行结果如下:

"webscraping.xpath" time used: 100.677000046 seconds. "lxml" time used: 2.09100008011 seconds. "re" time used: 0.138999938965 seconds.

结果很震撼:

- 正则表达式只用了0.14秒;

- lxml的xpath用了2.1秒;

- webscraping的xpath用了101秒!

由于xpath简单而且灵活,我们在爬虫开发的时候一般都会首选,但是通过这个实验发现它的效率远低于正则表达式,尤其是webscrpaing库中的xpath速度更是慢得恐怖。

因此,在我们的爬虫开发过程中,应该首选正则表达式,如果用正则表达式实在难于实现,再考虑xpath,另外,在使用xpath的时候一定要选用高效的库,比如lxml。特别是在数据量特别大的时候,效率显得尤为重要。

特别说明:本文旨在技术交流,请勿将涉及的技术用于非法用途,否则一切后果自负。如果您觉得我们侵犯了您的合法权益,请联系我们予以处理。

☹ Disqus被Qiang了,之前所有的评论内容都看不到了。如果您有爬虫相关技术方面的问题,欢迎发到我们的问答平台:http://spider.site-digger.com/