前段时间做裁判文书网的项目,要将Word格式的.doc文件内容转换为text文本内容,由于项目实施是布署在Linux服务器上的,所以要在Linux下实现word批量转text的操作。鲲之鹏的技术人员先后尝试了多种方法,现摘要记录印象较深的两个方法,以做备忘。

(1)用soffice命令行实现doc转txt

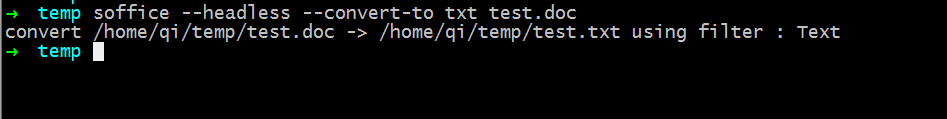

在Linux下可以用LibreOffice的soffice命令行来实现Word文件转txt文件,其命令行格式如下:

soffice --headless --convert-to txt test.doc --outdir txt_dir

命令行运行如下:

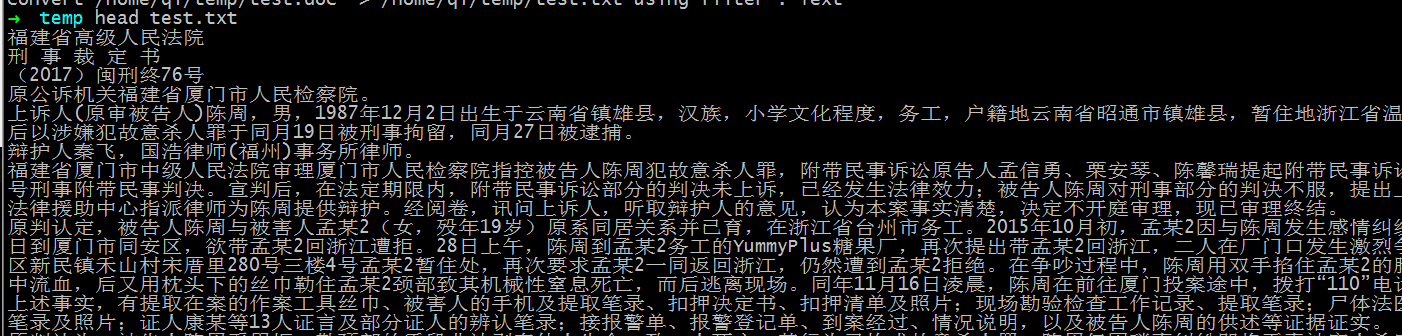

转换的结果如下:

可见,用此方法提取出来的文本数据会失去原有的段落结构,文字内容较多时就不容易看清原有的段落了。

另外,更大的问题是,soffice似乎不支持并行转换,笔者在尝试在多线程或多进程中进行批量处理时发现,程序在应用soffice 转换时会不定期地卡死,而在单进程单线程处理时则正常。

顺便说一下,soffice除了可以将Word文件转换为txt文件,也可以将Word文件转换为html文件,命令行格式如下:

soffice --headless --convert-to html test.doc --outdir html_dir

经测试发现,用soffice转换生成的html文件,效果还是很不错的。不过可惜的是不能支持并行转换。

(2)用docx2txt模块实现doc转txt

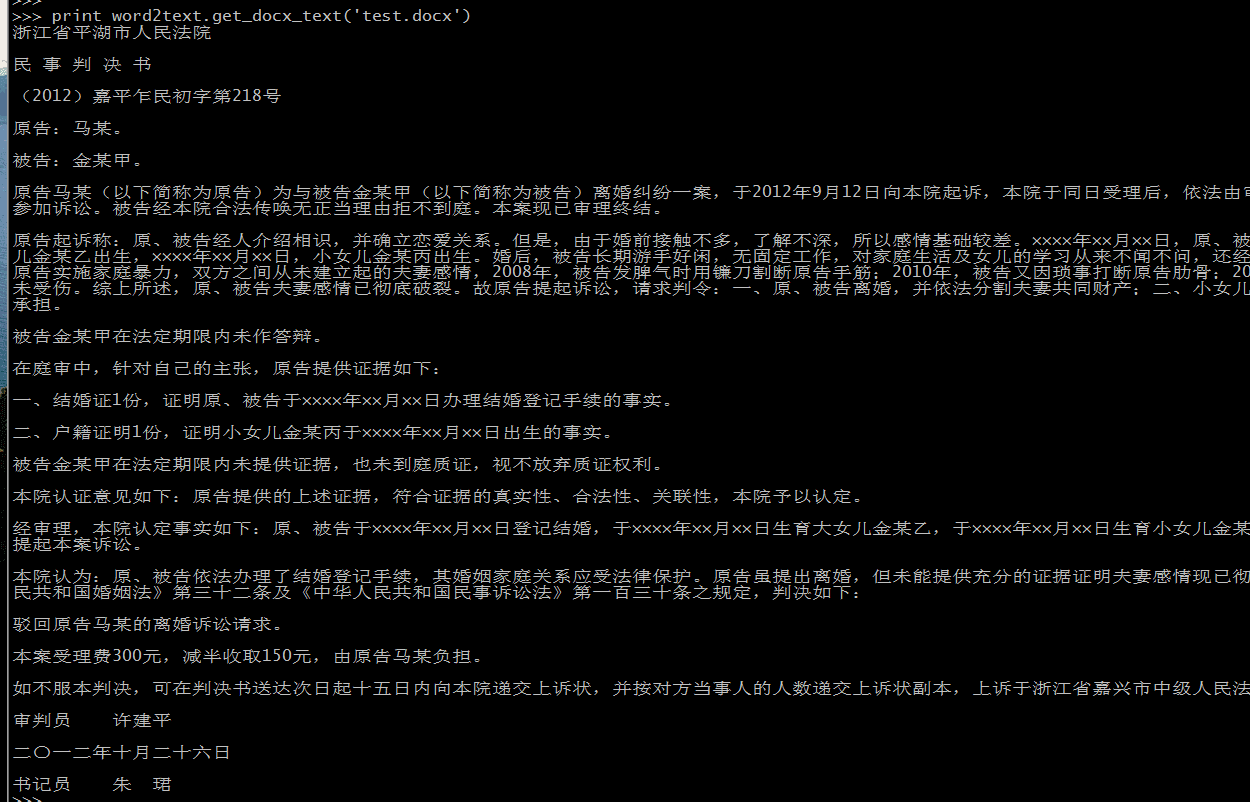

通过查阅资料,鲲之鹏的技术人员了解到Word的文本数据都在document.xml文件里存着,只要解压Word文档就能看到这个文件。所以,可以从document.xml文件中获取到Word文档的纯文本数据。而python-docx2txt模块就可以实现这样的处理。

从Word文档中提取纯文本数据:

可见,提取出来的文本数据会保留原有的段落结构,而且从显示的结果来看,更贴近原始Word文档的段落结构。更重要的是,经鲲之鹏的技术人员测试,python-docx2txt模块可以很好地支持多进程、多线程的批量处理,这对于大批量的文档处理来说,无疑是个好消息。

需要说明的是,python-docx2txt模块只能将Word文档内容转换为纯文本,而不能直接转为html格式。

另外,除python-docx2txt模块外,python-docx模块也能从Word文档中提取纯文本数据,应用方法也是一样的。不同的是,python-docx2txt模块看起来貌似写的更完善,而python-docx模块除了能提取wrod文件中的文本数据,从其说明文档上看似乎还能编辑word文件,不过这一点笔者并没有尝试。

现将两个模块的获取路径记录于此:

◆ python-docx

◆ python-docx2txt

特别说明:本文旨在技术交流,请勿将涉及的技术用于非法用途,否则一切后果自负。如果您觉得我们侵犯了您的合法权益,请联系我们予以处理。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。 您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。 数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。