2017年1月份备受关注的微信小程序功能正式上线了,好多知名平台纷纷推出了自己的微信小程序,例如大众点评、美团外卖、京东购物。对于我们爬虫开发者来说这绝对是好事情,意味着又多了一个数据来源,又多了一种选择。

用过微信小程序的人都知道无论是从界面上看还是从功能上看都和普通的手机App并没有什么差别。那么客户端与服务端数据交互的方式是否也一样呢?从微信小程序开发文档上了解到,产品模式下微信小程序强制要求客户端和服务端通过HTTPS协议进行交互(传统的手机App并没有这种限制),而不允许不安全的HTTP。这就意味着如果直接抓包(例如,使用Wireshark),我们看到的也是一堆乱码(HTTPS数据是加密传输的),无法了解交互的接口和过程。然而这一点并不难突破。

鲲之鹏的技术人员之前曾介绍过Web协议调试神器Fiddler,它最强大的地方就是能够抓取并明文展示HTTPS报文。它抓取HTTPS的原理是这样的,首先Fiddler

是以HTTPS代理模式工作的,当Fiddler接收到客户端(浏览器)CONNECT请求时,它冒充服务端(网站)接受客户端的请求,并回送客户端一个伪造的证书,并冒充客户端(浏览器)和真实的服务端(网站)建立连接,之后它就充当一个中间人的角色,向服务端(网站)转发客户端(浏览器)的请求数据,向客户端(浏览器)转发服务端(网站) 的应答数据。对于这个中间人来说两边的请都是和其直接建立的,所以两边发送的数据它都能解密成明文。

下面鲲之鹏的技术人员以“京东购物”微信小程序为例,介绍如何分析、抓取一个微信小程序的数据:

- 1)安装Fiddler4,启用HTTPS抓取。并允许远程连接。

- 2)手机Wifi确保和安装Fiddler的机器在一个局域网内。并在手机Wifi里设置好Fiddler代理。

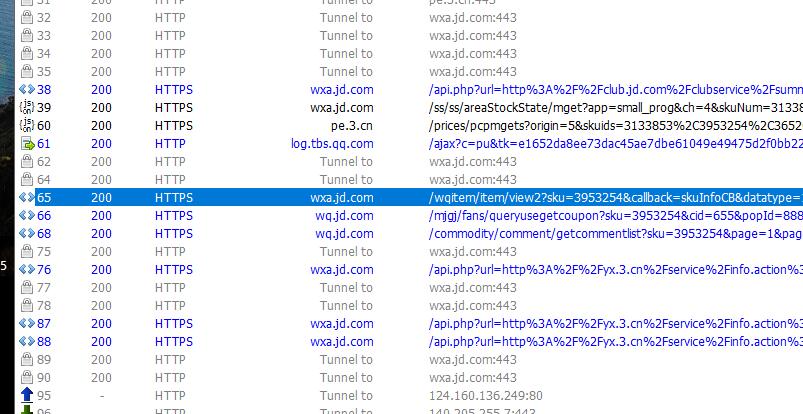

- 4)操作小程序,不出意外的话,就能看到Fiddler抓到的数据包。如下图所示。

- 5)有过手机App抓包经验的开发者会发现这个微信小程序的抓包分析过程其实和手机App的抓包分析过程完全一样。鲲之鹏的技术人员分析了几个微信小程序,发现目前微信小程序的数据基本上都没有做什么有效的防护策略(例如 签名机制),意味着一旦我们分析到数据接口(URL和参数)就可以轻易拿到我们想要的数据。例如京东购物的商品详情接口,我们只需要修改其中的商品ID参数,就可以拿到不同商品详情信息(标题、价格、规格、参数、评论、卖家信息),如下图所示。

相信在不就的将来各厂商会意识到这个问题并加强对数据的保护,就像传统的手机App一样。总之,各位:“欲抓从速!”

特别说明:本文旨在技术交流,请勿将涉及的技术用于非法用途,否则一切后果自负。如果您觉得我们侵犯了您的合法权益,请联系我们予以处理。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。 您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。 数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。