更多>>关于我们

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

西安鲲之鹏网络信息技术有限公司从2010年开始专注于Web(网站)数据抓取领域。致力于为广大中国客户提供准确、快捷的数据采集相关服务。我们采用分布式系统架构,日采集网页数千万。我们拥有海量稳定高匿HTTP代理IP地址池,可以有效获取互联网任何公开可见信息。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

您只需告诉我们您想抓取的网站是什么,您感兴趣的字段有哪些,你需要的数据是哪种格式,我们将为您做所有的工作,最后把数据(或程序)交付给你。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

数据的格式可以是CSV、JSON、XML、ACCESS、SQLITE、MSSQL、MYSQL等等。

更多>>技术文章

高速网页缓存方案分享-SSDB缓存 快了不是一点点!

发布时间:2015-06-06

鲲鹏数据的技术人员认为一套成熟可靠的的采集系统方案必须具备数据缓存功能,因为:

1)有了页面缓存,在二次运行的时候(比如,添加了字段)可以避免重复下载,大大减少运行时间。特别是针对那些对IP访问频率有限制的网站。

比如,某点评网站拥有超过千万的页面,网站对IP访问频率有限制(太快会出现验证码),完整下载一遍需要一个月左右的时间。如果没有做页面缓存,当客户要求添加一个字段的时候只能重新再下载一遍,就需要再等一个月的时间。而有了页面缓存,就可以在数小时内完成二次运行。

2)有了页面缓存,可以帮助我们查找问题。在数据提取和页面显示不一致时就有据可查。

鲲鹏数据的技术人员一直在努力探索最好的页面缓存方案,因为读写缓存的速度对整个采集的速度影响很大。

我们先后尝试了SQLite、MongoDB以及直接操作文件系统的方案:

1)SQLite,比如我们使用的webscraping库中的PersistentDict就是使用SQLite3作为后端存储实现的。

优点:便携(无依赖),无需额外配置,单文件便于迁移。

缺点:速度非常慢。不支持网络访问。

2)MongoDB。

缺点:配置复杂、占用存储空间特别大,速度差强人意。

3)直接操作文件系统。我们之前开源的KPCache库就是基于此(http://www.site-digger.com/html/articles/20140123/74.html)。

优点:无需额外配置,兼容所有平台。速度也的确快了很多(100万6KB文档,写入耗费1000秒)。

缺点:由于方案本身的缺陷,对磁盘inode数量占用很大,海量零散文件,数据难以迁移和销毁。

近日,我们又尝试了SSDB(http://ssdb.io/),它号称是Redis的替代者,并且存储容量不受限于系统内存的大小(Redis的存储容量受限于系统内存大小)。测试结果相当令人满意!

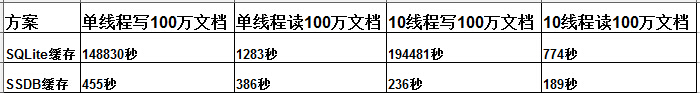

下面是我们做的一个对比实验:

测试对象:

1)用SQLite做后端的缓存(下面简称SQLite缓存),已将代码公开在这里:https://bitbucket.org/richardpenman/webscraping/src/49c4bbbcfcb6fcd2c3a8e13063fd11ad99b447e3/pdict.py。

2)用SSDB做后端的缓存(下面简称SSDB缓存),代码见这里https://bitbucket.org/snippets/kunzhipeng/qyEyy/ssdb。

测试环境:Ubuntu 12.04 LTS,16核CPU(2.27GHZ),24GB RAM。

测试过程:

1)单线程写100万个文档(单个大小为10KB)。

2)单线程读100万个文档。

3)多线程(10个线程)写100万个文档(单个文档大小为10KB)。

4)多线程(10个线程)读100万个文档。

下面是测试耗时的对比结果:

多线程情况下SSDB缓存写速度高达4237个页面/秒,读速度高达5291个页面/秒!秒杀之前的任何方案。

我们将在实际的大规模采集项目中对SSDB缓存方案做更多的测试,届时将会向大家分享更多的测试结果。

总结一下SSDB的优缺点:

优点:速度快(上面的测试结果显而易见)、支持网络访问。自带数据压缩功能,占用存储空间小。

缺点:经过我们测试,目前SSDB的Windows版本在多线程环境下还不稳定(经常出现socket timeout的问题),因此不建议大家在Windows环境下使用。

特别说明:本文旨在技术交流,请勿将涉及的技术用于非法用途,否则一切后果自负。如果您觉得我们侵犯了您的合法权益,请联系我们予以处理。

☹ Disqus被Qiang了,之前所有的评论内容都看不到了。如果您有爬虫相关技术方面的问题,欢迎发到我们的问答平台:http://spider.site-digger.com/